L’IA est introduite dans les environnements réglementés à un rythme accéléré. De la gestion de la qualité à la surveillance des risques, les organisations subissent des pressions pour adopter des analyses et une automatisation plus avancées. Mais un problème critique commence à faire surface, qui n’a pas grand-chose à voir avec la performance et tout à voir avec la responsabilité. Lorsqu’un système prend une décision, celle-ci peut-elle être expliquée, défendue et vérifiée?

Dans les secteurs réglementés, cette question n’est pas théorique. Elle est opérationnelle.

Le problème n’est pas l’intelligence, mais la responsabilité

La plupart des stratégies d’adoption de l’IA reposent sur une hypothèse discrète. Si un modèle est précis, il a de la valeur. Cette logique fonctionne dans les environnements où les résultats sont plus importants que les processus. Elle s’effondre dans les secteurs où les décisions doivent être justifiées, documentées et traçables.

Un écart de qualité, un score de risque ou une alerte de conformité n’est pas un simple résultat. C’est un élément qui peut devoir être examiné par les auditeurs, les régulateurs ou les équipes de gouvernance interne. Si le raisonnement qui sous-tend ce résultat ne peut être clairement compris, l’organisation hérite du risque au lieu de le réduire.

C’est là que l’IA “boîte noire” devient problématique. Non pas parce qu’elle manque de capacité, mais parce qu’elle manque de transparence.

Quand la boîte noire de l’IA entre en conflit avec la réglementation

Les modèles à boîte noire fonctionnent d’une manière qui obscurcit la façon dont les décisions sont prises. Même lorsqu’ils sont performants, ils introduisent un décalage entre le résultat et l’explication. Dans un contexte réglementé, ce décalage crée des frictions.

Lorsqu’un auditeur demande pourquoi un écart a été signalé ou pourquoi une décision a été prise, la réponse “le système l’a déterminé” n’est pas suffisante. L’organisation doit montrer comment les données, le contexte du processus et les règles ont contribué à ce résultat. Sans cette visibilité, la responsabilité devient floue et la gouvernance commence à s’affaiblir.

Plus subtilement, les systèmes “boîte noire” rendent le changement difficile. Les réglementations évoluent. Les processus changent. Les profils de risque changent. Si la logique qui sous-tend les décisions ne peut être comprise, il devient extrêmement difficile d’évaluer l’impact de ces changements dans l’ensemble de l’organisation.

Ce qui semble être un outil puissant au départ peut rapidement devenir quelque chose qui ne peut pas être adapté en toute sécurité.

L’explicabilité modifie complètement le rôle de l’IA

L’IA explicable est souvent considérée comme une amélioration technique, comme si elle rendait simplement les modèles plus faciles à interpréter. Dans les environnements réglementés, elle apporte quelque chose de plus fondamental. Elle permet à l’IA de participer à la gouvernance.

Lorsque les décisions peuvent être retracées jusqu’aux intrants, aux étapes du processus et aux relations contextuelles, elles peuvent être réexaminées, remises en question et améliorées.

Les résultats de l’IA cessent d’être des signaux isolés et s’intègrent dans une structure décisionnelle plus large.

Cette évolution est importante car les organismes réglementés ne fonctionnent pas sur la base d’informations isolées.

Ils fonctionnent sur des systèmes interconnectés où les processus, les risques, les contrôles et les obligations de conformité sont étroitement liés.

L’explicabilité permet à l’IA d’exister au sein de ce système plutôt qu’en dehors.

Pourquoi la plupart des initiatives en matière d’IA s’enlisent dans des environnements réglementés

De nombreuses organisations abordent l’IA comme une couche qu’elles peuvent ajouter aux systèmes existants. Des modèles sont introduits, des informations sont générées et des tableaux de bord sont élaborés. Mais il y a quelque chose qui ne colle pas.

Le problème n’est pas l’IA elle-même. C’est l’absence d’une structure sous-jacente qui relie ces connaissances au fonctionnement réel de l’organisation.

Sans lien clair avec les processus, les rôles, les risques et les contrôles, les résultats de l’IA restent abstraits. Ils peuvent informer, mais ils ne peuvent pas conduire à une action gouvernée. C’est pourquoi de nombreuses initiatives produisent des informations intéressantes mais ne se traduisent pas par une amélioration opérationnelle ou une valeur de conformité.

Le fossé est architectural.

Quand l’Interfacing fait passer l’explicabilité de la théorie à l’exécution

La plupart des plateformes parlent d’explicabilité au niveau du modèle. Le véritable défi est l’explicabilité opérationnelle, c’est-à-dire la possibilité de retracer une décision à travers l’entreprise elle-même.

C’est là que l’Interfacing devient matériellement différent. Parce que la plateforme structure l’organisation comme un modèle opérationnel connecté, l’explicabilité n’est pas quelque chose d’ajouté à l’IA. Il s’agit d’une propriété du fonctionnement du système.

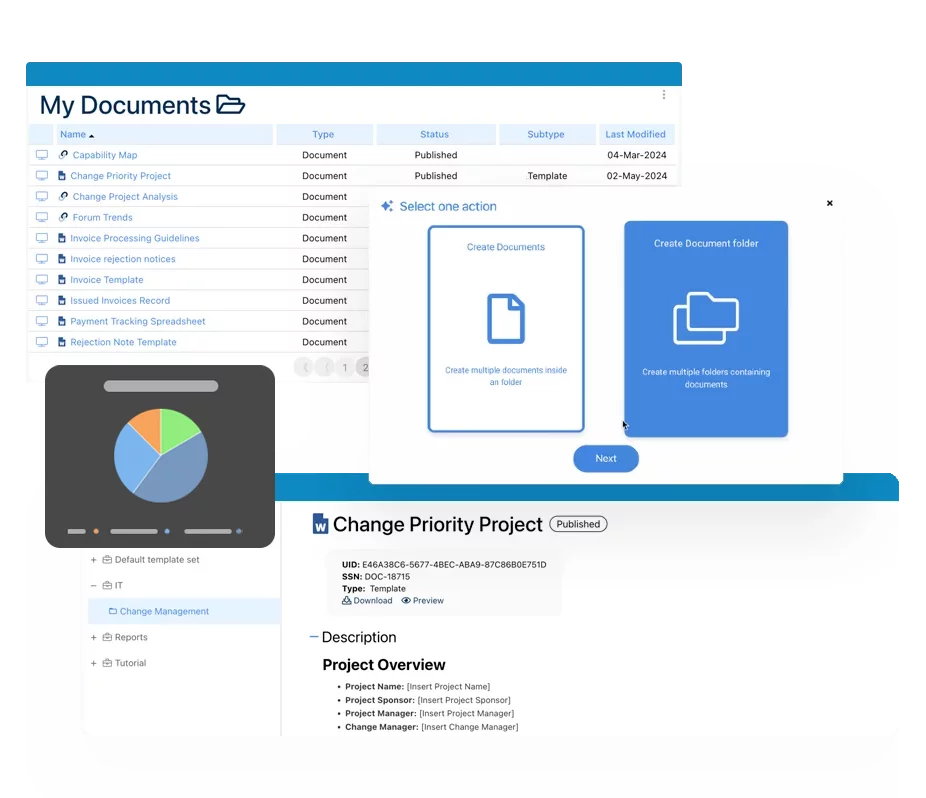

Considérez un écart de qualité.

Dans un environnement classique, un modèle d’intelligence artificielle peut signaler une anomalie. L’étape suivante est une enquête manuelle. Les équipes tentent de comprendre quel processus a échoué, quel contrôle a été inefficace et qui est responsable. L’information existe, mais l’explication doit être reconstituée.

Dans Interfacing, ce même événement est déjà ancré dans le contexte.

L’écart est directement lié à :

- le processus au cours duquel il s’est produit

- les risques et les contrôles associés

- les procédures et documents de référence

- les rôles responsables et les parties prenantes

Comme ces relations sont modélisées dans le système, le “pourquoi” du problème n’est pas déduit après coup, il est visible immédiatement.

C’est ce qui rend l’explicabilité opérationnelle.

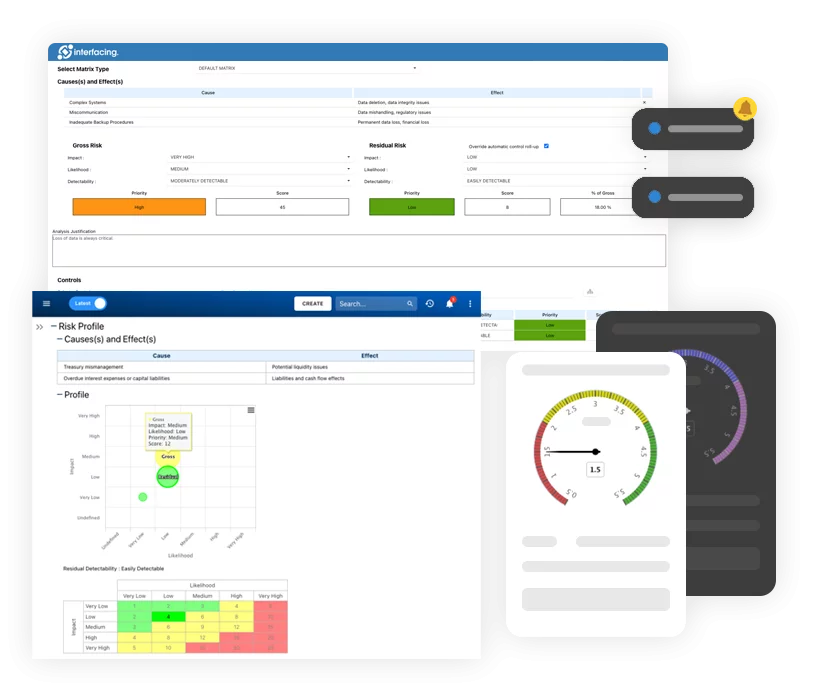

La capacité de la plateforme à relier les processus, les risques, les contrôles, les données et les exigences réglementaires dans un référentiel unique permet aux organisations d’effectuer des analyses d’impact réelles plutôt que des suppositions.

Etendez maintenant cette réflexion aux changements réglementaires.

Lorsqu’une réglementation est mise à jour, la plupart des organisations réalisent des analyses d’impact manuellement. Elles recherchent des documents, identifient les processus concernés et tentent de déterminer les effets en aval.

Avec Interfacing, cette analyse devient structurée.

Comme les règlements, les processus, les contrôles et les actifs sont déjà liés, le système peut.. :

- identifier les processus concernés

- mettre en évidence les contrôles et les risques concernés

- déclencher des révisions et des approbations basées sur le flux de travail

Il ne s’agit pas seulement d’automatisation. Il s’agit d’une gestion du changement explicable. Chaque décision, chaque mise à jour, chaque approbation est traçable et enregistrée.

Le même principe s’applique à l’état de préparation à l’audit.

Au lieu de préparer des preuves de manière réactive, les organisations opérant dans le cadre d’Interfacing se maintiennent :

- des pistes d’audit complètes des modifications

- une documentation contrôlée par version

- des flux de travail et des approbations traçables

Ces capacités sont intégrées dans la couche de gouvernance de la plateforme, y compris les journaux d’audit, le contrôle des versions et les contrôles de système validés conçus pour les environnements réglementaires.

Cela signifie que lorsqu’un auditeur demande comment une décision a été prise, la réponse n’est pas reconstruite. Elle est déjà documentée dans le système.

De la connaissance à l’action, le chaînon manquant

L’une des lacunes les plus courantes dans l’adoption de l’IA est la distance entre la compréhension et l’exécution. Un modèle peut identifier un risque ou prédire un problème, mais l’organisation doit encore décider de ce qu’il faut faire ensuite, qui est responsable et comment cette action est suivie.

Dans un environnement axé sur la gouvernance, cette transition est intégrée.

Lorsque les informations sont reliées aux flux de travail, les actions correctives peuvent être lancées, suivies et validées au sein du même système. Les décisions ne sont pas seulement prises, elles sont enregistrées, traçables et vérifiables. Au fil du temps, cela crée une boucle de rétroaction qui améliore à la fois les processus et la prise de décision.

C’est là que l’explicabilité prouve sa véritable valeur. Il ne s’agit pas seulement de comprendre les décisions après coup. Il s’agit de permettre aux décisions d’être gérées dans le cadre d’un système opérationnel continu.

La réglementation s’oriente vers la transparence, elle ne s’en éloigne pas

Les attentes en matière de réglementation évoluent dans le même sens. Dans tous les secteurs, l’accent est mis de plus en plus sur l’intégrité des données, l’auditabilité et la validation des systèmes. On attend des organisations qu’elles démontrent non seulement qu’elles sont conformes, mais aussi comment elles maintiennent cette conformité en permanence.

Cette tendance ne favorise pas les systèmes opaques.

Même si les réglementations n’imposent pas explicitement l’IA explicable, elles exigent les résultats que l’explicabilité rend possibles. La traçabilité des décisions, la clarté des pistes d’audit et la responsabilité des processus ne sont pas facultatives. Ils sont fondamentaux.

Repenser la question

La conversation autour de l’IA se concentre souvent sur les capacités. Quel est le degré d’avancement du modèle ? Quelle est la précision des prédictions ?

Dans les secteurs réglementés, ces questions sont secondaires.

La question principale est de savoir si les décisions peuvent être gouvernées.

L’IA “boîte noire” a du mal à s’imposer dans cet environnement parce qu’elle sépare l’intelligence de la responsabilité. L’intelligence artificielle explicable et intégrée aux processus les réunit.

Conclusion

L’IA n’est pas intrinsèquement incompatible avec les secteurs réglementés. Mais c’est la manière dont elle est mise en œuvre qui détermine si elle devient un actif ou un passif.

Lorsque l’IA fonctionne sans contexte, elle introduit de l’incertitude. Lorsqu’elle est intégrée dans un système structuré et gouverné, elle accroît la visibilité, améliore la prise de décision et renforce la conformité.

L’explicabilité n’est pas une fonctionnalité que les organisations peuvent choisir d’ajouter ultérieurement. Il s’agit d’une condition préalable à l’utilisation responsable de l’IA dans des environnements où chaque décision doit résister à un examen minutieux.

Pourquoi choisir Interfacing?

Avec plus de deux décennies de logiciels d'IA, de qualité, de processus et de conformité, Interfacing continue d'être un leader dans l'industrie. À ce jour, nous avons servi plus de 500+ entreprises de classe mondiale et des sociétés de conseil en gestion de toutes les industries et de tous les secteurs. Nous continuons à fournir des solutions numériques, cloud et IA qui permettent aux organisations d'améliorer, de contrôler et de moderniser leurs processus tout en allégeant le fardeau de la conformité réglementaire et des programmes de gestion de la qualité.

Pour en savoir plus ou discuter de la manière dont Interfacing peut aider votre organisation, veuillez remplir le formulaire ci-dessous.

Documentation : Piloter la transformation, la gouvernance et le contrôle

• Obtenez des informations complètes et en temps réel sur vos opérations.

• Améliorez la gouvernance, l'efficacité et la conformité.

• Assurez une conformité fluide avec les normes réglementaires.

eQMS : Automatiser les workflows de qualité et de conformité & rapports

• Simplifiez la gestion de la qualité avec des workflows automatisés et une traçabilité continue.

• Standardisez la gestion des CAPA, des audits fournisseurs, de la formation et des workflows associés.

• Transformez la documentation en informations exploitables pour la Qualité 4.0.

Développement rapide d'applications low-code : Accélérer la transformation numérique

• Créez rapidement des applications personnalisées et évolutives.

• Réduisez le temps et les coûts de développement.

• Adaptez-vous rapidement pour répondre aux besoins évolutifs des clients et de votre entreprise.

L’IA pour transformer votre entreprise !

Conçus pour optimiser les opérations, l'efficacité et renforcer la conformité. Découvrez nos solutions alimentés par l’IA :

• Répondre aux questions des employés.

• Transformer des vidéos en processus.

• Recommander des améliorations de processus et des impacts réglementaires.

• Générer des formulaire, processus, risques, réglementations, KPIs, et bien plus.

• Fragmenter les normes réglementaires

Request Free Demo

Document, analyze, improve, digitize and monitor your business processes, risks, regulatory requirements and performance indicators within Interfacing’s Digital Twin integrated management system the Enterprise Process Center®!

Approuvé par nos clients à travers le monde !

Plus de 400 entreprises de classe mondiale et cabinets de conseil en gestion.

INTEGRATION

Approuvé par les nos clients dans le monde entier !

Plus de 400 entreprises de classe mondiale et cabinets de conseil en gestion.